李彦宏找到“救命药”(组图)

2月28日晚间,百度公布了其2023年第四季度及全年财报。过去一年中百度实现了总营收1345.98亿元,归属百度的净利润(non-GAAP)达到287亿元,年增速高达39%。尤其是在第四季度,营收和净利润分别达到349.51亿元和77.55亿元,同比增长44%。

出品|虎嗅科技组作者|齐健编辑|王一鹏头图|视觉中国

2023年,百度核心收入达到1034.65亿元,核心净利润(non-GAAP)为274亿元,同比增长38%。百度App月活跃用户数达到6.67亿。其中,萝卜快跑的总服务量突破500万单,四季度服务单数同比增长49%,在武汉地区全无人驾驶订单比例高达45%。

虽然财报业绩表现良好,但财报发布翌日,百度开盘即下跌超6%,截至2月29日收盘,百度集团跌6.61%。

本次财报中,百度仍保持对AI的高度关注。

“近期我们开始从文心一言中获得增量收入;2024年相信这一增量收入将增加到数十亿元人民币,主要来自广告和人工智能云业务。”百度创始人、董事长兼首席执行官李彦宏对文心一言未来的盈利能力信心十足,他介绍说,百度的AI云收入增长已至十亿元人民币,并持续提高盈利能力。

不断增长的模型构建需求正在促进百度的AI业务增长,李彦宏说:“随着分布式推理的增加,我们看到越来越多的企业,特别是科技公司,转向我们的公共云来构建他们的模型。”

在快速增长的AI市场需求中,李彦宏似乎真的找到了“救命的药”。

百度智能云翻身了?

百度智能云的业绩表现是本次财报中的亮点之一。

“本季度百度智能云总营收84亿元。”财报电话会上李彦宏透露,其中大模型为云业务带来约6.56亿元增量收入,生成式AI和基础模型的收入占AI云收入的8%。

目前国内云厂商中只有阿里云,每季度固定在集团财报中公布云业务的营收和盈利情况。

百度在2023年第一季度首次公布了智能云业务盈利的消息,虽未公布具体盈利数字,但开始在财报电话会上透露业务的营收数字。2023年第一季为42亿元,第二季为45亿元,到第四季度一跃升到84亿元,百度智能云2022全年营收为177亿。

从营收看,百度智能云俨然已经乘着AI热潮,开始在云市场翻身了。

然而,仅仅依靠AI业务的增长并不能完全保证百度智能云在激烈竞争的中国云市场中长期稳定地发展。尽管AI技术是当前云计算市场的一大热点,百度智能云借助其在大模型和生成式AI领域的技术优势实现了显著的营收增长,但整个市场的竞争格局远比这更复杂。

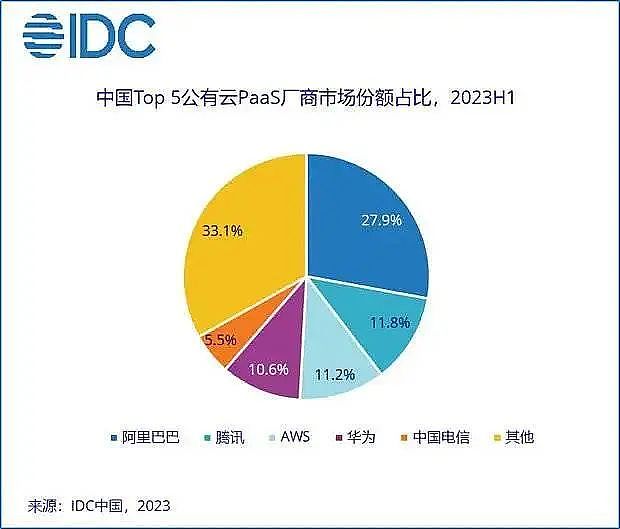

2023上半年中国Top 5公有云PaaS厂商市场份额占比 | 来源:IDC中国

2023上半年中国Top 5公有云PaaS厂商市场份额占比 | 来源:IDC中国

首先,国内云市场的竞争不仅仅围绕技术能力展开,还涉及到价格策略、服务质量、产品多样性等多个维度。就在百度发布2023年年度财报的第二天,阿里云官宣了全面降价的策略,基本宣告了国内云市场全面拉开价格战序幕。

一年时间里,阿里云已经连续两次降价,作为国内云市场头部厂商,其价格战策略势必会对市场产生巨大影响,迫使其他云服务提供商不得不调整自己的定价策略以保持竞争力。面对阿里云,百度真的有实力打价格战吗?

在这种环境下,百度智能云要想吸引更多的企业用户,仅仅依靠AI技术的优势可能是不够的。云服务还需要在价格、服务和产品多样性上进行全面优化和提升。

除此以外,尽管AI业务为百度智能云带来了可观的增量收入,但在整个云计算市场中,AI业务仍然只是一部分。云计算市场的其他领域,如基础云服务(包括计算、存储和网络等)、云安全、云数据库等,仍然占据着市场的主要份额。这意味着百度智能云需要在这些领域也保持竞争力,才能在整个市场中占据更有利的位置。

文心一言怎么赚钱?

文心一言是百度智能云的核心卖点之一,不过李彦宏提出的“在2024年增量收入增加到数十亿元人民币”,并非只关注云业务,还包括了百度最传统的赚钱工具“广告”。

事实上,目前国内市场上的主流AI大模型中,只有文心一言已经明确了与广告相结合的商业化路径。过去一年中,Meta和谷歌在AI方面的商业化策略就一直重点关注与传统广告业务的深度融合,在这方面,百度所见略同。目前来看,广告也的确是文心一言在C端市场能够看到的最优商业路径。

一些业内人士告诉虎嗅,文心一言已经对广告主发布了报价,售卖形式仍包括传统的App广告,具体到广告如何与AI进行深度绑定,目前仍在探讨中。

文心一言目前也的确有开展广告业务的基础。

百度公布的数据显示,文心大模型的日调用量已超过5000万次,季度环比增长190%;12月,约有2.6万家企业调用文心大模型,季度环比增长150%。

在商业合作方面,百度与中国三星、荣耀等头部企业达成合作,特别是三星最新旗舰手机Galaxy S24系列集成了文心大模型的多项能力,展现了AI技术的商业应用潜力。此外,飞桨社区已聚集了1070万开发者,服务超过23.5万家企事业单位,显示出强大的生态构建能力。

三星的AI手机在中国将采用文心一言

三星的AI手机在中国将采用文心一言

除此之外,百度在2023年10月召开的百度世界大会上宣布的AI原生策略,到如今也已经初具成果。百度目前已经推出多个AI原生应用和营销工具,如百度新搜索、文心一言App等。这些创新不仅推动了百度App月活用户的增长,也带动了在线营销收入的提升,2023年全年达到751亿元。

此外,百度文库被重构为“一站式AI内容创作平台”,其AI功能极大提升了内容创作的效率与质量。百度文库在PPT生成领域的表现尤为出色,以86分的高分排名第一。

依托于文心一言日调用量的显著增长和与头部企业的合作,百度在广告领域的深耕确实有着更好的基础。

不过在今天来看,AI与广告融合的模式尚不能确定市场接受度如何,经济环境偏弱也导致了广告市场的不断变化。与此同时,用户对广告的敏感度日益增加,隐私保护的要求也越来越高,这些都使基于广告的AI商业模式面临巨大挑战。

百度AI的隐忧

虽然百度对2024年的AI市场充满希望,但文心一言的发展前路远不像百度自己描述的那样平坦。

首先,在国内大语言模型的同类产品中,一直标榜国内领先的文心一言,并没有排到第一。

在苹果App Store的效率类软件排行中,目前大语言模型类的对话App中,排名第一的是豆包,第二是文心一言,第三是讯飞星火,其后分别是通义千问、天工、Kimi。

截至发稿,豆包在iOS免费榜上排名39,而文心一言排名为102,排名第三的讯飞星火并没有进入前200名。

2023年11月,市场调研机构QuestMobile的一份数据显示,文心一言、豆包与讯飞星火的日活分别是155.4万、124.6万、71.9万。豆包的总体活跃用户数约为1143.89万人,略高于文心一言的977.82万人。豆包人均使用时长为24.34分钟,比文心一言的34.68分钟短了约1/3。

在模型能力方面,百度在10月17日宣布了文心一言的4.0版本,算是国内第一批宣布对齐GPT-4模型能力的AI大模型玩家。不过在此后的半年中,国内的阿里、智谱等公司也都陆续推出了能力更强的更新版本。

在UC伯克利的LMSYS Chatbot Arena Leaderboard大模型排名中,阿里巴巴的Qwen1.5-72B模型已经超越Claude 2.0和Gemini Pro (Dev API),排到第八名了,但榜单上并未出现百度的Ernie 4.0。

UC伯克利的LMSYS Chatbot Arena Leaderboard大模型排名

虽然此类排名并不能完全代表模型的实际能力,但也反映出AI业界对于文心一言的了解程度确实不够。多位AI业内人士、开发者曾向虎嗅表示,由于通义千问开源,且提供了多种模型尺寸,在开发者当中很受欢迎,其生态建设和模型能力都有迎头赶上的趋势。

除此之外,百度还面临一个国内所有AI公司都避不开的问题,GPU紧缺。财报显示,2023年Q4百度的研发费用为人民币63亿元(886百万美元),同比增加11%,主要由于支持生成式AI研发投入的服务器的折旧开支及服务器机架费增加。

有消息人士向虎嗅透露,2023年中百度曾多次斥巨资希望购入更多GPU,但相对于国内其他厂商来说,并未收获更多。

虽然百度曾多次公开表示,在显卡方面“存货很多”,但在实际应用中,存货显卡的问题正在逐步暴露。

首先,NVIDIA A100 和更高性能的 H100 显卡于 2022 年 10 月被禁止销售给中国大陆和香港。也就是说国内的高端GPU基本都是在此之前采购的。

虽然GPU没有那么爱坏,一般用上10年不成问题。但是一般而言,GPU服务器应该在部署后的3到5年重新评估性能和效率,并考虑更换或升级。这个时间框架考虑到了技术进步的速度和硬件在经过几年高负载工作后可能出现的性能下降。然而,有些服务器可能会在适当的维护和升级下使用更长的时间。

2020年英伟达首次发布了A100显卡,对比前代的V100性能大幅提升。到今天,A100已发布近四年,而英伟达的下一代主流高端显卡H200也马上进入发货期。

如今,国内厂商囤积的多数A100显卡,其实都在面临换代的问题。

“我们的AI芯片储备能够支撑我们在未来或几年内继续提高收益。”李彦宏认为,目前模型推理并不需要过于高端的GPU芯片。百度的储备和市场上现有的芯片足以为用户提供AI原生应用的动力。

为了进一步提升AI应用和模型的开发效率,百度智能云推出了千帆AppBuilder和千帆ModelBuilder两大工具,这些工具为开发者提供了更便捷的开发体验和更高效的模型调优能力。

“从长远来看,虽然我们无法获得最前沿的GPU,但我们拥有最高效的自制软件堆栈,用户体验不会受到影响。”李彦宏介绍说,得益于百度独有的四层AI架构优化,文心大模型的推理成本显著降低,同时训练效率得到持续提升。自发布以来,百度不断降低文心大模型的推理成本,目前已降低至去年3月版本的1%。

+61

+61 +86

+86 +886

+886 +852

+852 +853

+853 +64

+64